基本介紹

- 中文名:香農熵

- 外文名:Shannon entropy

- 實質:信息不確定性的多少

- 提出時間:1948 年

- 解決問題:解決了對信息的量化度量問題

- 套用學科:通信工程、計算機科學、電子科學

基本定義

實例

數學分析

計算

與熱熵的關係

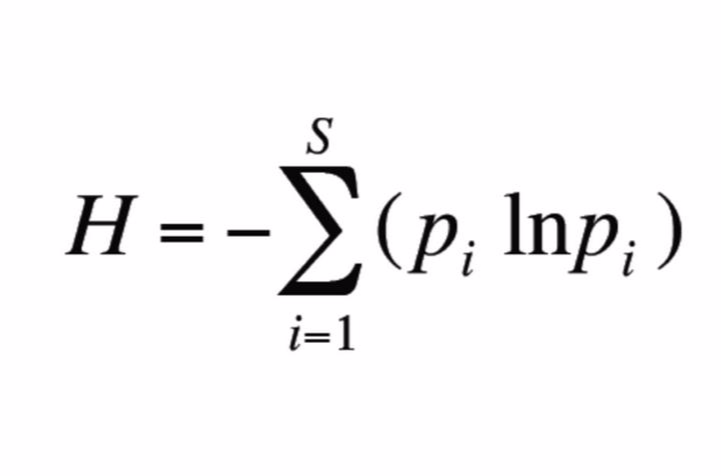

1948 年,香農提出了“信息熵”(shāng) 的概念,解決了對信息的量化度量問題。一條信息的信息量大小和它的不確定性有直接的關係。比如說,我們要搞清楚一件非常...

信息是個很抽象的概念。人們常常說信息很多,或者信息較少,但卻很難說清楚信息到底有多少。比如一本五十萬字的中文書到底有多少信息量。直到1948年,香農提出了“...

熵的概念是由德國物理學家克勞修斯於1865年所提出。最初是用來描述“能量退化”的物質狀態參數之一,在熱力學中有廣泛的套用。但那時熵僅僅是一個可以通過熱量改變...

熵定律是科學定律之最,這是愛因斯坦的觀點。我們知道能源與材料、信息一樣,是物質世界的三個基本要素之一,而在物理定律中,能量守恆定律是最重要的定律,它表明了...

克勞德·艾爾伍德·香農(Claude Elwood Shannon ,1916年4月30日—2001年2月24日)是美國數學家、資訊理論的創始人。1936年獲得密西根大學學士學位。1940年在麻省理工...

圖像熵(image entropy)是圖像“繁忙”程度的估計值。...... 圖像熵(image entropy)是圖像“繁忙”程度的估計值...熱力學的熵,引入到資訊理論,因此它又被稱為香農熵...

柯爾莫哥洛夫熵(Kolmogorov熵,以下簡稱K熵)是刻劃混沌系統的一個重要的量。在不同類型的動力學系統中,K熵的數值是不同的。...

量子統計力學中,馮紐曼熵(英語:von Neumann entropy)是經典體系吉布士熵概念的拓展延伸。...

在資訊理論中,香農的信源編碼定理(或無噪聲編碼定理)確立了數據壓縮的限度,以及香農熵的操作意義。信源編碼定理表明(在極限情況下,隨著獨立同分布隨機變數數據流的...

在資訊理論中,香農的信源編碼定理(或無噪聲編碼定理)確立了數據壓縮的限度,以及香農熵的操作意義。信源編碼定理表明(在極限情況下,隨著獨立同分布隨機變數數據流的...

6.5.2人群香農熵的構建6.5.3人群玻爾茲曼熵的構建6.5.4人群克勞修斯熵的構建6.5.53種人群熵的分析及總結6.6熵的性質及分析...