基本介紹

- 中文名:隱馬爾可夫模型

- 外文名:Hidden Markov Model

- 別稱:HMM

- 套用學科:數理統計學

引言

隱馬爾可夫模型(Hidden Markov Model,HMM)是統計模型,它用來描述一個含有隱含未知參數的馬爾可夫過程。其難點是從可觀察的參數中確定該過程的隱含參數。然後利用這些...

馬爾可夫模型(Markov Model)是一種統計模型,廣泛套用在語音識別,詞性自動標註,音字轉換,機率文法等各個自然語言處理等套用領域。經過長期發展,尤其是在語音識別中的...

隱馬爾可夫模型實際上是標準馬爾可夫模型的擴展,可以用λ=(A,B,π)三元組來簡潔的表示一個隱馬爾可夫模型。而因子隱馬爾科夫模型(FHMM) 是隱 Markov 模型 (...

隱馬可夫模型(Hidden Markov Model, HMM)是一連串事件接續發生的機率,用以探索看不到的世界/現象/事實的數學工具,是機器學習(Machine Learning)領域中常常用到的...

馬爾可夫模型是由 Andrei A Markov於1913年提出來的,作為一種統計模型,廣泛套用 在語音識別,詞性自動標註,音字轉換,機率文法等各個自然語言處理等套用領域。馬爾可夫...

此外作為結構最簡單的馬爾可夫模型(Markov model),一些機器學習算法,例如隱馬爾可夫模型(Hidden Markov Model, HMM)、馬爾可夫隨機場(Markov Random Field, MRF)和...

內容簡介本書屬於數理金融(量化投資)的範疇, 論述了隱馬爾可夫鏈和馬爾可夫狀態轉換模型的數學原理、數值算法及在量化投資中的套用。出於完備性的考慮, 本書的前兩...

風險管理等方面的最新套用進展.全書共安排8章內容,第1章介紹馬爾可夫鏈、隱馬爾可夫模型和馬爾可夫決策過程的基本理論和方法,其餘7章分別介紹馬爾可夫鏈模型在不同...

聲學模型是語音識別系統中最為重要的部分之一,目前的主流系統多採用隱馬爾科夫模型進行建模。 隱馬爾可夫模型的概念是一個離散時域有限狀態自動機,隱馬爾可夫模型HMM...

《模型分類》是2003年9月機械工業出版社出版的圖書,作者是(美)迪達,譯者是...3.10 隱馬爾可夫模型 3.10.1 一階馬爾可夫模型 3.10.2 一階隱馬爾可夫模型...

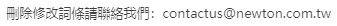

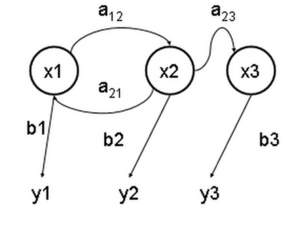

在正常的馬爾可夫模型中,狀態對於觀察者來說是直接可見的。這樣狀態的轉換機率便是全部的參數。而在隱馬爾可夫模型中,狀態並不是直接可見的,但受狀態影響的某些變數...

機率圖理論共分為三個部分,分別為機率圖模型表示理論,機率圖模型推理理論和機率圖模型學習理論。[2] 基本的機率圖模型包括貝葉斯網路、馬爾可夫網路和隱馬爾可夫網路...

主要內容包括空域和小波域圖像統計模型的建立、參數估計、期望最大值算法及其改進,以及多解析度分析技術、馬爾可夫隨機場與模糊聚類算法有機地結合在圖像降噪與分割中的...

11.3.2隱馬爾可夫模型11.4馬爾可夫鏈模型的套用本章小結重要概念和術語思考與練習題本章推薦閱讀資料第12章灰色系統理論12.1灰色系統基本概念12.2灰色關聯分析...

在圖像統計模型中,一幅影像I被認為是具有機率密度函式p(I)的影像集的一個隨機...1. 鄧磊著.SAR圖像處理方法:Contourlet域隱馬爾可夫模型的套用:測繪出版社,2009....

HSMM 即隱半馬爾可夫模型,又稱連續可變持續的HMM、分段模型,是一種能夠通過可觀測數據很好地描述真實空間統計特性的隨機模型。...

HMMs是指隱馬爾科夫模型,是一種算法模型,用於語言信號處理,是對語音信號的時間序列結構建立統計模型。...

1、隱馬爾可夫模型;2、因子分析;3、主成分分析;4、偏最小二乘回歸;5、潛在語義分析和機率潛在語義分析;6、EM算法。潛變數貝葉斯算法和方法 編輯 貝葉斯統計通常...

1.改進隱馬爾可夫模型在生物序列分析中的套用研究,四川省教育廳重點項目,主持2.人工合成小麥群體成熟胚組織培養特性的遺傳分析,國家自然科學基金項目,主研...

隱馬爾可夫模型,盲目的信號分離使用特徵提取的技術降維(例如,主成分分析,獨立分量...在神經網路模型,自組織映射(SOM)和自適應共振理論(藝術)是常用的無監督學習算法...