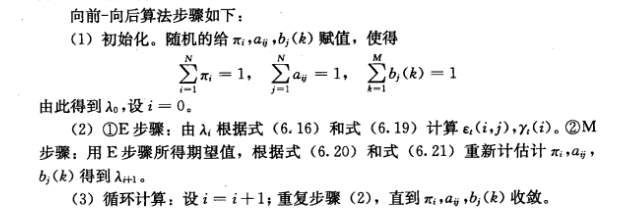

訓練HMM的標準算法是向前-向後算法(forward-backward algorithm)或者叫做鮑姆一韋爾奇算法(Baum—Welch algorithm),這是期望最大化算法(Expectation—Maximization algorithm,簡稱EM算法)的一種特殊情形。這個算法將幫助我們訓練HMM的轉移機率A和發射機率B。

基本介紹

- 中文名:廣義向前向後算法

- 外文名:forward-backward algorithm

- 又稱:鮑姆-韋爾奇算法

- 定義:訓練HMM的轉移機率和發射機率

- 屬於:EM算法的一種特殊情形

- 套用學科:計算機原理

概述,步驟,