核心思想

霍普菲爾德提出的神經網路模型有兩個重要成分,即儲存信息和提取信息。在典型的對稱性霍普菲爾德模型中,其系統的

動力學趨於使能量函式達到最小值,

生物學的噪聲或

神經元的背景活動可用溫度表征,這就使

神經網路具有

統計力學或

熱力學的特性。霍普菲爾德模型及其統計力學理論不僅增加了神經網路的理論概念,還發展了神經網路的計算方法,解決了網路中神經單元數與儲存模式數量之間的關係,以及網路噪聲與神經單元儲存效率之間的關係。霍普菲爾德提出的能量函式和網路自由能概念是其理論的基石。網路從高能狀態到達最小能量函式狀態,則得到收斂,給出穩定的解,完成網路功能,這是該理論的核心思想。這種理論實際上把腦看成由大量結構簡單、動作相同的單元組成,與固體物理學的模型——

自旋玻璃(spin glass)相似,每個單元的方向和位置是隨機的,由這些單元在相空間相互競爭所確定。對於整個網路來說,如果各神經元之間的聯結強度是對稱的,且其變化是非同步的,那么網路不斷變化,進行疊代直至收斂於某一點;如果網路中全部神經元的變化是同步的,那么網路變化是周期性的;如果各神經元之間的聯結是非對稱性的,那么網路可出現定點收斂、周期性變化和混沌等三種狀態。

霍普菲爾德網路結構

霍普菲爾德網路結構分類

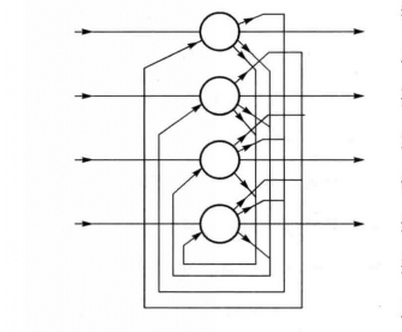

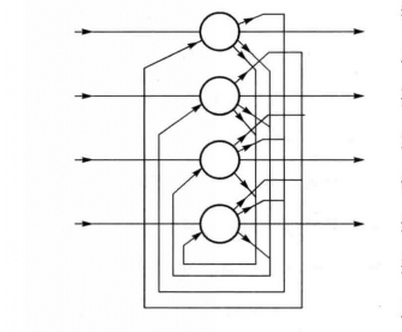

Hopfield神經網路按照處理輸入樣本的不同,可以分成兩種不同的類型:離散型(DHNN)和連續型(CHNN)。前者適合於處理輸入為二值邏輯的樣本,主要用於聯想記憶;後者適合於處理輸入為模擬量的樣本,主要用於分布存儲。前者使用一組非線性差分方程來描述神經網路狀態的演變過程;後者使用一組非線性微分方程來描述神經網路狀態的演變過程。

離散型的Hopfield網路是一種全反饋式網路,其特點是任一神經元的輸出均通過聯結權重反饋到所有神經元作為輸入,其目的是讓任一神經元的輸出都能受所有神經元輸出的控制,從而使各神經元的輸出能夠相互制約。

連續型Hopfield網路的拓撲結構與離散型Hopfield網路相似,所不同的是,連續型Hopfield網路中節點的狀態為模擬值且連續變化。基於生物存儲器基本思想,Hopfield在1984年提出了連續時間的神經網路模型。

特點

霍普菲爾德(Hopfield)提出神經網路作為存儲處理理論。霍普菲爾德網路具有以下特徵:

1.分散式表達(Distribute Representation)。通過激活跨越一組處理元件的模型進行存儲記憶,而且存儲是三相重疊的,在同一組處理元件上以不同的模擬方式,表示不同的記憶。

2.分布異步控制(Distributed,Asynchronous Control)。每個處理元件的功能是根據它自身的狀態來作判斷。所有局部作用相加就是整體的解決方法。

3.相關存儲器(Content-Addressable Memory)。一個模型在網路中可以進行存儲。如果我們想要跟蹤一個模型,只需要確定其中一部分,那么網路就會自動找到相適應的匹配。

4.容錯(Fault Tolerance)。如果有少數處理單元不起作用或出故障,那么網路的功能還能發揮作用。

作用

霍普菲爾德網路不僅數學處理非常精緻,而且網路提出兩年後,霍普菲爾德就設計出模擬該網路性質的電子線路,為模型的套用提供了成功的範例。最有名的就是運用霍普菲爾德網路解決NP難解問題中的典型問題——旅行商問題,結果在很短的時間內,網路就提供了滿意的答案。佩爾頓(Pelton,M.)把這一問題看作是最最佳化問題。

霍普菲爾德網路是具有一定規模和靈活聯結關係的多層神經網路,在刻畫網路的整體狀態時,霍普菲爾德指出網路狀態的連續變化過程其實就是能量極小化的過程,當聯結權重對稱時系統就處於某種穩定狀態,這就為網路動力學的穩定性提供了證據。由於他把穩定平衡點與正確的儲存狀態相對應,從而為聯想儲存提供了明確的物理解釋。這種網路從系統功能角度出發,強調神經元的集體功能,初步顯示了按內容定址的聯想記憶的性質。這一切均表明霍普菲爾德網路對人腦的模擬研究更加接近真實生物腦的情況,但它與生物腦之間的差距仍然是當代科學無法跨越的。因為,儘管人腦是由

個

神經元構成的,但單個神經元之間的關係卻並不是隨機的,神經元的位置和作用,不僅由千萬年進化的系統發生決定,而且還由每個人出生後十多年的個體發育決定,所以腦內神經元的相互關係並不像固體物理自旋玻璃那樣,是吸引子隨機相互作用的相空間。生物腦的能量變化並不像淬火模型那樣達到能量最小的穩定狀態而收斂;相反,腦的能量代謝是有源的,從較小能量平衡態到全系統高能不平衡態,或達到某一局部最高能態時,才得到解。

局限性

霍普菲爾德網路雖然能實現聯想記憶功能,但由於其記憶內容不可改變,因而不具備學習能力。而且這種網路能夠正確記憶和回顧的樣本數是相當有限的。如果記憶的樣本數太多,網路可能收斂於一個不同於所有記憶中樣本的偽模式;如果記憶中某一樣本的某些分量與別的

記憶樣本的對應分量相同時,這個

記憶樣本可能是一個不穩定的平衡點。而且當網路規模一定時,所能記憶的模式非常有限。一般情況下,我們把網路所能儲存的最大模式數稱為

網路容量,網路容量與網路的規模、算法以及記憶模式的向量分布都有關係。隨著記憶模式數的增加,權值不斷移動,各記憶模式相互交叉,當模式數超過網路容量時,網路不但逐漸遺忘以前記憶的模式,而且也無法記住新模式,這就說明當網路規模一定時,要記憶的模式數越多,聯想時出錯的可能性越大;反之,要求的出錯機率越低,網路的信息儲存容量的上限就越小。

霍普菲爾德網路結構

霍普菲爾德網路結構